AI tạo sinh (Generative AI – GenAI) đang mở ra một kỷ nguyên mới cho mọi ngành nghề, từ sáng tạo nội dung, phân tích dữ liệu cho đến hỗ trợ ra quyết định. Tuy nhiên, cùng với tốc độ ứng dụng mạnh mẽ, GenAI cũng kéo theo hàng loạt rủi ro bảo mật, bao gồm cả nguy cơ bị rò rỉ dữ liệu. AI đang tạo ra những đột phá mới, nhưng cũng mở ra những lỗ hổng bảo mật chưa từng có. Theo Gartner, các cuộc tấn công dựa trên AI sẽ trở thành một trong những mối đe dọa lớn nhất đối với doanh nghiệp trong thời gian tới.

AI tạo sinh (GenAI) – Lợi thế chiến lược cho doanh nghiệp hiện đại

Không thể phủ nhận rằng GenAI đang tạo ra những chuyển biến tích cực rõ rệt trong cách các nhà lãnh đạo và tổ chức vận hành. Theo khảo sát năm 2024 của McKinsey, 53% các giám đốc điều hành (C-level) đã sử dụng GenAI thường xuyên trong công việc, vượt xa so với con số 44% ở cấp quản lý trung gian. Điều này cho thấy GenAI không chỉ là xu hướng công nghệ, mà đang trở thành một phần không thể thiếu trong quá trình ra quyết định, hoạch định chiến lược và phát triển kinh doanh.

Cũng theo Forrester, AI Agent là một trong những công nghệ đột phá nhất năm 2025. Khả năng hỗ trợ doanh nghiệp vận hành thông minh, phản hồi tức thời và tối ưu hiệu suất hoạt động đã giúp AI Agent được các tổ chức lớn như Aflac, Atlantic Health System, Legendary Entertainment hay NASA’s Jet Propulsion Laboratory nhanh chóng tích hợp vào hệ thống của mình. Các tập đoàn công nghệ như Salesforce (với Agentforce), ServiceNow và Microsoft cũng đang dẫn đầu xu hướng khi phát triển các nền tảng GenAI dành riêng cho doanh nghiệp.

Việc triển khai GenAI không chỉ dừng lại ở việc tự động hóa mà còn mở ra khả năng sáng tạo nội dung có tính cá nhân hóa cao, phân tích dữ liệu phức tạp trong thời gian thực và giảm đáng kể chi phí vận hành.

Đối với lĩnh vực an ninh mạng, các mối đe dọa an ninh mạng ngày càng tinh vi, đòi hỏi các tổ chức, doanh nghiệp phải sử dụng trí tuệ nhân tạo (AI) và tự động hóa để phát hiện, ngăn chặn và ứng phó nhanh chóng với các cuộc tấn công.

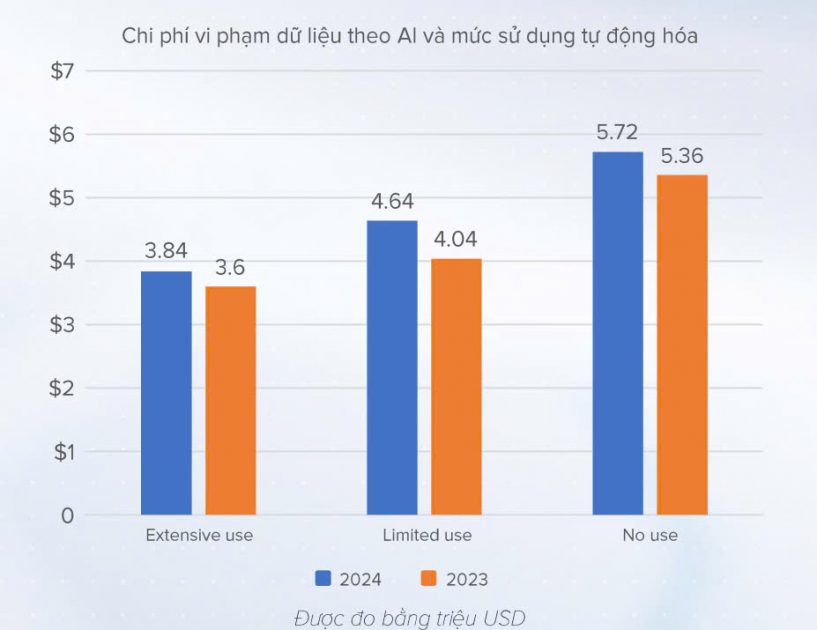

Theo Báo cáo Tổng kết an ninh mạng 2024 – Dự đoán 2025 của VSEC cũng chỉ ra rằng các tổ chức sử dụng AI-driven security có thể phát hiện và giảm thiểu tác động của cuộc tấn công nhanh hơn 27% so với những tổ chức không có AI. Điều này giúp tiết kiệm chi phí trung bình 1,76 triệu USD trong quá trình khắc phục sự cố.

Khi trí tuệ nhân tạo trở thành lỗ hổng bảo mật mới

Bên cạnh những lợi ích mà công cụ AI tạo sinh mang lại, những sự cố gần đây như vụ rò rỉ dữ liệu tương tác của hơn 34 triệu người dùng trong vụ việc liên quan đến OmniGPT, hay thống kê của Check Point cho thấy cứ 13 prompt sử dụng AI tạo sinh thì có một prompt chứa thông tin nhạy cảm, đang gióng lên hồi chuông cảnh báo về những rủi ro rất thực mà công nghệ này mang lại nếu không được kiểm soát đúng cách.

Một trong những thách thức lớn nhất nằm ở chính bản chất kỹ thuật của các hệ thống GenAI. Các mô hình ngôn ngữ lớn (LLM) như ChatGPT có xu hướng “ghi nhớ” thông tin trong quá trình huấn luyện, dẫn đến khả năng vô tình tái tạo lại các dữ liệu nhạy cảm, từ thông tin cá nhân đến mã nguồn nội bộ.

AI tạo sinh đang bị lạm dụng để tạo ra các deepfake, từ đó thực hiện các hành vi lừa đảo tài chính, tấn công lừa đảo và đánh cắp danh tính. Sự xuất hiện của các video và âm thanh giả mạo siêu thực gây khó khăn cho việc xác thực thông tin và làm suy giảm lòng tin vào các hệ thống phòng thủ truyền thống.

Đại diện của VSEC nhận định: “Những cuộc tấn công sử dụng AI sẽ trở thành một thách thức nghiêm trọng đối với ngay cả đội ngũ an ninh mạng lành nghề nhất, khi số lượng và độ phức tạp của các mối đe dọa tăng theo cấp số nhân”.

Báo cáo năm 2024 của Netskope cho thấy 46% các vi phạm chính sách dữ liệu liên quan đến GenAI có liên quan đến việc chia sẻ mã nguồn độc quyền với các mô hình công khai. Cùng lúc, nghiên cứu của LayerX chỉ ra rằng khoảng 6% nhân viên thường xuyên dán dữ liệu nhạy cảm trực tiếp vào các công cụ GenAI, làm gia tăng đáng kể nguy cơ rò rỉ dữ liệu không mong muốn.

Không chỉ dừng lại ở sự bất cẩn của người dùng, GenAI còn đang trở thành mục tiêu của các cuộc tấn công có chủ đích. Một hình thức đặc biệt nguy hiểm là prompt injection – kỹ thuật khiến mô hình lộ ra dữ liệu huấn luyện thông qua các prompt được thiết kế tinh vi.

“Kỹ thuật “prompt injection” cũng cho phép kẻ tấn công điều khiển LLM tạo ra các phản hồi sai lệch hoặc đánh cắp dữ liệu. Sự xuất hiện của các LLM độc hại là điều dễ hiểu khi nó có khả năng mô phỏng các LLM chính thống, đặt ra những thách thức mới trong việc xác thực và bảo vệ người dùng”, chuyên gia VSEC nêu quan điểm.

Khi các doanh nghiệp tích hợp GenAI vào quy trình vận hành, khả năng bị khai thác ngày càng tăng. Bên cạnh đó, việc xử lý dữ liệu xuyên biên giới khiến vấn đề tuân thủ pháp lý trở nên phức tạp hơn nhiều. Theo dự báo của Gartner, đến năm 2027, khoảng 40% các vi phạm bảo mật liên quan đến AI sẽ đến từ việc triển khai GenAI không phù hợp trong môi trường toàn cầu.

Song song với đó, thị trường an ninh mạng đang chứng kiến làn sóng đầu tư mạnh vào công nghệ bảo vệ GenAI. Từ năm 2023, tổng vốn đầu tư vào các giải pháp phòng thủ GenAI đã vượt mức 2,9 tỷ USD. Một trong những ví dụ tiêu biểu là AI Guardian của SentinelOne – nền tảng sử dụng học tăng cường để tự động ngăn chặn đến 94% các cuộc tấn công bằng prompt injection mà vẫn đảm bảo tốc độ xử lý dưới 200 mili giây.

Sự trỗi dậy của AI tạo sinh đòi hỏi các tổ chức và cá nhân phải nâng cao cảnh giác và đầu tư vào các giải pháp an ninh mạng tiên tiến. Đồng thời, cần có sự phối hợp chặt chẽ giữa các nhà nghiên cứu, chuyên gia và cơ quan quản lý để chủ động ứng phó với các mối đe dọa ngày càng gia tăng này.