Tấn công social engineering (tấn công phi kỹ thuật) – thao túng con người để đạt được mục tiêu tấn công – vốn không phải là điều mới. Tuy nhiên, cách thức thực hiện các cuộc tấn công này đang thay đổi nhanh chóng nhờ sự hỗ trợ của trí tuệ nhân tạo (AI).

Tấn công Social Engineering: Lợi dụng danh tính thật để lừa đảo

Theo các chuyên gia an ninh mạng, social engineering (tấn công phi kỹ thuật) là nguyên nhân chính của hầu hết các vụ rò rỉ dữ liệu. Các biện pháp phòng vệ truyền thống vốn đã gặp khó khăn trong việc ngăn chặn hình thức tấn công này, và giờ đây, với sự hỗ trợ của trí tuệ nhân tạo, tin tặc có thể thực hiện các cuộc tấn công nhanh hơn, quy mô lớn hơn và tinh vi hơn bao giờ hết.

Trước đây, kẻ tấn công thường sử dụng các phương pháp thô sơ như mặt nạ silicon để giả mạo danh tính. Một ví dụ điển hình là vụ lừa đảo liên quan đến Jean-Yves Le Drian, cựu Bộ trưởng Quốc phòng Pháp. Hai kẻ giả mạo đã dùng mặt nạ silicon để đóng giả ông trong các cuộc gọi video, thậm chí còn tạo dựng một phông nền giống văn phòng làm việc của ông. Kết quả là chúng đã lừa đảo hơn 55 triệu euro từ nhiều nạn nhân, trong đó có một giao dịch lên tới 47 triệu euro với lý do chuộc con tin tại Syria.

Tuy nhiên, mặt nạ silicon không thể bắt chước hoàn hảo chuyển động của khuôn mặt người thật. Giờ đây, trí tuệ nhân tạo đã cung cấp một công cụ mạnh mẽ hơn: deepfake video. Năm ngoái, một vụ lừa đảo tại HongKong đã sử dụng công nghệ này để giả mạo giám đốc tài chính (CFO) trong một cuộc họp video, thuyết phục nhân viên chuyển khoản 25 triệu USD vào tài khoản của kẻ tấn công.

Tấn công bằng giả mạo giọng nói (Vishing)

Vishing (Voice phishing) là một biến thể của social engineering, trong đó kẻ tấn công sử dụng giọng nói để thuyết phục nạn nhân cung cấp thông tin hoặc thực hiện hành động bất lợi cho tổ chức.

Kẻ tấn công thường đóng giả một nhân vật có uy tín – chẳng hạn như nhân viên ngân hàng, quản lý cấp cao hoặc chuyên gia IT – rồi tạo ra cảm giác cấp bách để buộc nạn nhân hành động ngay lập tức. Các cuộc gọi này có thể yêu cầu chuyển tiền hoặc cung cấp thông tin đăng nhập. Theo thống kê năm 2022, các nạn nhân trung bình mất khoảng 1.400 USD do các cuộc tấn công này.

Với sự hỗ trợ của trí tuệ nhân tạo, kẻ tấn công có thể sao chép giọng nói của bất kỳ ai chỉ từ vài giây ghi âm. Điều này khiến nạn nhân dễ dàng tin tưởng mà không nghi ngờ. Một ví dụ đáng sợ là vụ lừa đảo khi một người mẹ nhận được cuộc gọi từ một kẻ giả danh con gái mình, nói rằng cô đã bị bắt cóc và yêu cầu 50.000 USD tiền chuộc. Với công nghệ này, các biện pháp phòng thủ truyền thống như xác minh qua số điện thoại trở nên kém hiệu quả hơn bao giờ hết.

Tấn công phishing qua email: Từ “Spray and Pray” đến Email lừa đảo tinh vi

Hầu như ai cũng từng nhận được email thông báo rằng họ vừa trúng một giải thưởng lớn hoặc được một vị “hoàng tử” nhờ giúp chuyển tiền. Đây là một trong những phương pháp phishing lâu đời nhất, nhưng nó vẫn là hình thức tấn công mạng phổ biến nhất hiện nay.

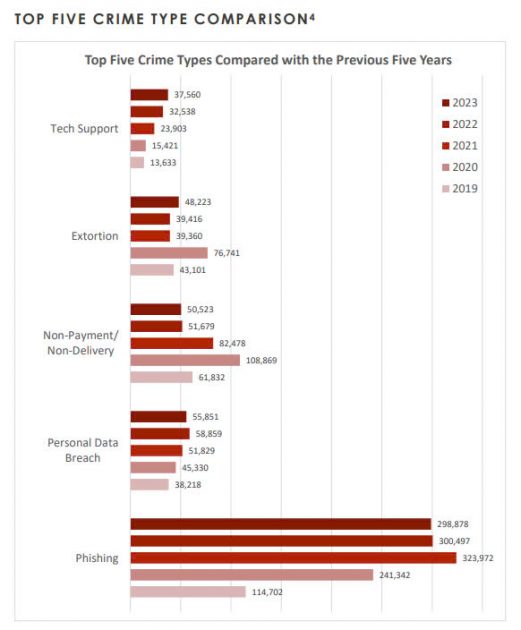

Trước đây, các email phishing thường dễ bị phát hiện do lỗi ngữ pháp, nội dung không liên quan hoặc sử dụng phương thức chuyển tiền đáng ngờ. Ngoài ra, các bộ lọc thư rác và công cụ bảo mật cũng giúp ngăn chặn đáng kể các email dạng này. Theo báo cáo của FBI năm 2023, đã ghi nhận 298.878 vụ tấn công liên quan đến phishing, cao hơn rất nhiều so với các hình thức tấn công khác.

Ngày nay, kẻ tấn công có thể sử dụng LLM để tạo ra những email phishing hoàn hảo, không còn lỗi chính tả hay ngữ pháp. Trí tuệ nhân tạo cũng giúp cá nhân hóa nội dung email theo từng nạn nhân, từ đó nâng cao hiệu quả của spear phishing – hình thức tấn công lừa đảo qua email nhắm mục tiêu cụ thể.

Không chỉ vậy, trí tuệ nhân tạo còn có thể dịch nội dung sang nhiều ngôn ngữ khác nhau, giúp tin tặc mở rộng phạm vi tấn công đến những khu vực ít có hiểu biết về phishing. Theo Harvard Business Review, AI có thể tự động hóa hoàn toàn quá trình phishing, giảm chi phí thực hiện đến 95% nhưng vẫn đạt hiệu quả tương đương hoặc cao hơn so với cách làm thủ công.

Mối đe dọa mới đòi hỏi chiến lược phòng thủ vững chắc

An ninh mạng luôn là một cuộc chạy đua giữa tấn công và phòng thủ. Nhưng với sự hỗ trợ của trí tuệ nhân tạo, cuộc chiến này đã bước sang một giai đoạn khác, nơi con người không còn có thể dễ dàng phân biệt thật – giả.

Kẻ tấn công khai thác tâm lý con người để thực hiện hành vi lừa đảo một cách tinh vi. Chúng lợi dụng sự tin tưởng bằng cách giả mạo đồng nghiệp, thuyết phục nạn nhân bỏ qua các quy trình bảo mật. Chúng tận dụng sự tôn trọng cấp trên, giả danh giám đốc tài chính (CFO) để yêu cầu thực hiện giao dịch khẩn cấp. Và chúng gieo rắc sự sợ hãi, tạo ra tình huống nguy cấp nhằm thúc ép nạn nhân hành động ngay lập tức mà không kịp suy xét.

Những bản năng này đã phát triển hàng ngàn năm, nhưng chúng ta không thể thích nghi nhanh như cách AI đang thay đổi thế giới. Một giải pháp quan trọng là doanh nghiệp cần triển khai các giải pháp bảo mật hiện đại để có thể thích nghi với bối cảnh các cuộc tấn công đang không ngừng phát triển và tinh vi hơn bao giờ hết.

Theo các chuyên gia VSEC, các công cụ AI tạo sinh có thể tăng độ tin cậy của các vụ tấn công gian lận lên mức khiến chúng rất khó phân biệt với thực tế. Vì vậy, việc nâng cao nhận thức, kiểm tra kỹ lưỡng thông tin, và áp dụng các biện pháp bảo mật là chìa khóa giúp bạn tránh trở thành nạn nhân của các chiêu trò này.