Cục Điều tra Liên bang (FBI) gần đây đã phát đi cảnh báo về sự gia tăng các hoạt động lừa đảo trực tuyến sử dụng trí tuệ nhân tạo (AI). Các chuyên gia VSEC cho biết, AI không chỉ giúp tội phạm tạo nội dung nhanh chóng mà còn tăng độ tin cậy và mức độ thuyết phục của các chiêu trò này.

Nhờ AI, tin tặc giờ đây có thể thực hiện các vụ lừa đảo trên quy mô lớn hơn, từ các chiến dịch tuyển dụng giả mạo đến lừa đảo đầu tư và tống tiền. Theo các chuyên gia VSEC, các hình thức lừa đảo sử dụng AI để thao túng nạn nhân có thể dưới dạng:

- Tạo tài khoản mạng xã hội giả:

Tội phạm dùng AI để tạo văn bản, hình ảnh, và video nhằm thiết lập tài khoản mạng xã hội chân thực, từ đó thực hiện các cuộc tấn công phi kỹ thuật, lừa đảo qua email, hoặc giả danh trong các mối quan hệ tình cảm trực tuyến. - Mạo danh người có thẩm quyền:

AI giúp giả giọng nói, video, và hình ảnh, cho phép tội phạm mạo danh giám đốc điều hành, nhân viên chính phủ, hoặc cơ quan thực thi pháp luật. Điều này giúp chúng dễ dàng yêu cầu thanh toán hoặc thông tin cá nhân từ nạn nhân. - Quảng cáo đầu tư giả mạo:

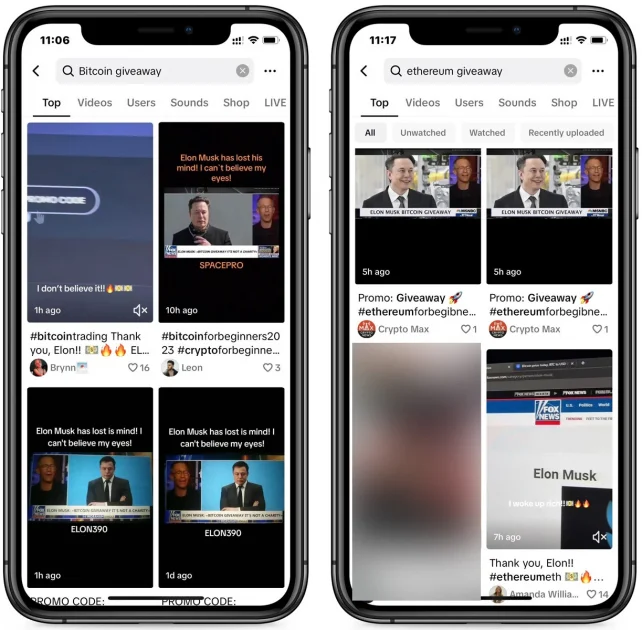

Tội phạm sử dụng nội dung quảng cáo sinh động được tạo bởi AI để thiết kế các tài liệu và trang web lừa đảo đầu tư, đặc biệt nhắm vào lĩnh vực tiền điện tử. - Deepfake và tống tiền:

Các video deepfake chứa nội dung nhạy cảm được tạo ra để tống tiền nạn nhân. Những video này thường nhằm vào người nổi tiếng hoặc người dễ bị tổn thương. - Lời kêu gọi từ thiện giả mạo:

AI được sử dụng để tạo hình ảnh và video giả về các thảm họa thiên nhiên hoặc xung đột. Tội phạm sau đó kêu gọi quyên góp cho các tổ chức từ thiện không có thật, lợi dụng lòng tin và sự đồng cảm của nạn nhân.

Ngoài ra, trên thế giới cũng đã ghi nhận một số trường hợp điển hình cho thấy mức độ nguy hiểm của việc lạm dụng AI như các video deepfake với hình ảnh người nổi tiếng như Elon Musk được phát tán trên mạng xã hội để dụ dỗ nạn nhân đầu tư vào các dự án tiền điện tử giả mạo.

Gần đây hơn, Google Mandiant đưa tin rằng các nhân viên CNTT từ Triều Tiên đã sử dụng AI để tạo hồ sơ giả xin việc ở các tổ chức toàn cầu. Khi được thuê, họ không chỉ kiếm tiền cho Triều Tiên mà còn thực hiện gián điệp mạng hoặc triển khai phần mềm độc hại trong hệ thống công ty.

Theo chuyên gia VSEC, các công cụ AI tạo sinh có thể tăng độ tin cậy của các vụ tấn công gian lận lên mức khiến chúng rất khó phân biệt với thực tế. Dưới đây là một số biện pháp hữu ích trong hầu hết các tình huống để giúp công chúng nhận diện và phòng tránh các vụ lừa đảo:

- Xác minh danh tính:

Thiết lập từ hoặc cụm từ bí mật với người thân để kiểm tra danh tính. Lưu ý các dấu hiệu bất thường trong hình ảnh hoặc video, chẳng hạn như bàn tay bị méo mó, khuôn mặt không cân đối, hoặc bóng đổ không tự nhiên. - Nhận diện giọng nói:

Trong các cuộc gọi đáng nghi, chú ý đến tông giọng hoặc cách dùng từ không tự nhiên, vì đây có thể là giọng nói được tạo ra bởi AI. - Hạn chế chia sẻ công khai:

Giữ tài khoản mạng xã hội ở chế độ riêng tư, chỉ chấp nhận kết nối với người đáng tin cậy. Hạn chế chia sẻ hình ảnh và video công khai để tránh bị kẻ xấu sử dụng. - Xác minh thông tin:

Nếu nhận được cuộc gọi hoặc email yêu cầu thông tin nhạy cảm, hãy cúp máy và tự tìm kiếm thông tin chính thức của tổ chức hoặc cá nhân đó để xác minh. Không phản hồi trực tiếp qua kênh mà bạn nhận được. - Bảo vệ tài sản:

Không gửi tiền, mua gift cards, hoặc giao dịch tiền điện tử cho những người không rõ danh tính. Tuyệt đối không cung cấp thông tin nhạy cảm qua điện thoại hoặc trực tuyến.

Trí tuệ nhân tạo mang lại nhiều lợi ích to lớn nhưng cũng tiềm ẩn nguy cơ nghiêm trọng khi bị lạm dụng. Các âm mưu lừa đảo sử dụng AI ngày càng trở nên tinh vi và khó phát hiện hơn. Vì vậy, việc nâng cao nhận thức, kiểm tra kỹ lưỡng thông tin, và áp dụng các biện pháp bảo mật là chìa khóa giúp bạn tránh trở thành nạn nhân của các chiêu trò này.